2025 年 7 月 7 日,我写了《放弃Cursor,我依然选择了Claude断供后的Windsurf》。

10 天之后,7 月 17 日,又写了《Claude Sonnet 4模型重磅回归Windsurf平台,Pro用户每月250次免费调用》,记录 Claude 4 回到 Windsurf 的那个节点。

今天是 2025 年 12 月 7 日。

过去这 5 个月里,AI 开发工具几乎是按“周”为单位在进化:新模型、AI CLI、AI IDE、各种计费方式轮番登场。

但回头看我自己的真实使用情况,有两个事实没变:

- AI 助手侧的主力,依然是:Codex + Claude Code

- IDE 侧的主战场,依然是:Windsurf

也就是说,我现在稳定使用的组合其实是:

Codex(大脑) + Claude Code(执行者) + Windsurf(车间)

在这种前提下,Windsurf 要想长期留在我的桌面上,必须满足两个条件:

- 自己内置的模型要强,而且价格要有诚意

- IDE 功能要真正在“理解和改造代码仓库”上有独到之处,而不是做个聊天壳子

这一篇,就围绕这两点展开。

一、先交代立场:我的主力依然是 Codex + Claude Code

先把话说清楚:

- 我不是那种“只用一个 AI 工具”的极端玩家

- 相反,我是一个重度 Codex CLI + Claude Code 用户

日常的分工,大概是这样的:

- Codex / Claude Code 负责:

- 写一次性脚本、运维命令、小工具

- 查 API、看文档例子、对比几种写法

- 帮我快速论证方案、写笔记、写 PR 描述、写文章

- Windsurf 负责:

- 打开真实项目仓库,做长期维护和重构

- 前端开发:浏览器预览 + 选中组件直接跳到对应代码

- 和 Cascade 一起改多文件、跑测试、看 diff

- 把 MCP、DeepWiki、Codemaps 这些“周边能力”串成一个完整工作流

换句话说:

Codex 是我最信任的 AI “大脑”, 生产各种架构图,方案设计 **Claude Code 是我最信任的 AI “执行者”, 执行各种脚本,运维命令,小工具 Windsurf 是把这些能力真正落在仓库里的“生产车间”,并且自己还带了一堆强模型。

正因为大脑已经很强,所以我看 Windsurf 的标准会更苛刻——它必须真的把 IDE 这一块做好,而且在模型和价格上不能“拉垮”。

二、模型和价格:一整排最新模型,被做成了“务实套餐”

很多人对 Windsurf 的印象还停留在“有点免费的模型”“用积分计费”。

但如果你把它现在支持的模型和积分倍率摊开,会发现一个有点离谱的事实:

它直接把一整排 2025 年这代最新、最强的模型,做到了非常朴素的定价结构里。

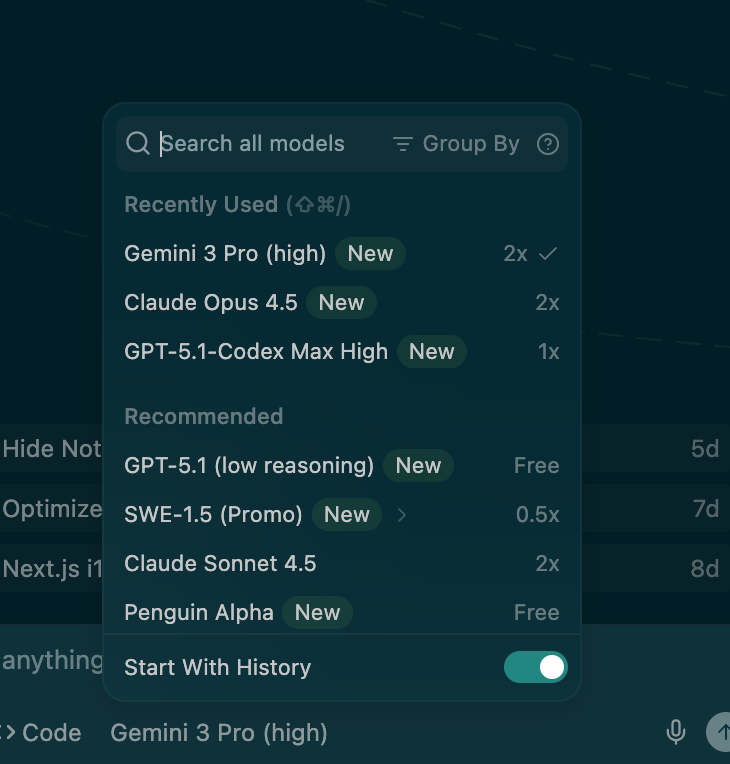

先看几组关键配置(以我写稿时看到的为准):

对付费用户几乎“白送”的模型:

GPT-5.1-CodexGPT-5.1-Low

从上架到现在,这两个基本就是“你只要是付费用户,就能一直用”的水平。

写业务代码、补全、改文件,这一档已经非常能打。针对认真写代码的高配档:

GPT-5.1-Codex Max Medium:0.5x creditGPT-5.1-Codex Max High:1x credit

翻译成人话:

- 日常重构、小规模复杂改动,用 Max Medium 就够——只要半价积分

- 遇到特别硬的骨头(复杂 bug、架构级重构),再切到 Max High,付“正常价” 1x 就行

顶级 Claude 4.5 系列:

Claude Opus 4.5:2x creditClaude Sonnet 4.5:2x credit

这俩都是现在市面上顶级的编程向模型。

在别的平台,经常要按量付费,而在 Windsurf 里就是很简单的“乘 2 倍积分”,并且Opus 4.5 在活动期间和Sonnet 4.5 价格一样。自研代码模型:

SWE-1.5:0.5x credit

这是专门为代码场景调的模型,价格低,日常补全和局部修改都很适合。

配合那张价格面板截图(image-4.png),感受会更直观:

一眼看过去,你会发现 Windsurf 在模型和价格上的几个特点:

- 把最新一代的 GPT-5.1 系列、Claude 4.5 系列拉了一个“从 0x 到 2x”非常简单的梯度

- 你可以用免费的 GPT-5.1-Codex / GPT-5.1-Low 打底

- 用 0.5x 的 GPT-5.1-Codex Max Medium / SWE-1.5 做日常开发主力

- 只有在需要最强战力时,才上 1x / 2x 的高配档

对我这种已经在为 Codex + Claude Code 付费的人来说,Windsurf 在模型这件事上的意义有两点:

- 兜底能力非常强:

当我不想切到 CLI、或者直接在 IDE 里一条龙搞定时,

Windsurf 内的这些模型完全足够当主力。 - 计费心理负担小:

不是“名义上无限制、实际各种黑盒限流”,

而是真正能做到——我知道自己每一次点模型,会烧掉多少积分。

这也是我为什么在上一轮“工具信任危机”之后,反而更愿意把仓库托付给 Windsurf 的原因之一:

钱是次要的,可预期才是核心。

还有一个经常被忽略、但对国内开发者极其现实的点:

- Windsurf 在国内网络环境下整体是“开箱即用”的,你可以直接用上 Claude 4.5、GPT-5.1-Codex 这一档一流模型;

- 而像 Cursor、国际版 Trea 这类工具,如果不折腾额外的网络手段,很多时候是连“登录 + 授权 + 调用顶级模型”这一步都走不顺的。

这就导致一个非常直接的差异:

哪怕大家都在宣传“支持 Claude / GPT / Gemini / 自研模型”,你在国内能不能稳定、连续地用到这些模型,其实差别非常大。在这件事上,Windsurf 确实是更省心的那一档。

三、DeepWiki + Codemaps:这是 Windsurf 真正“独一份”的地方

模型可以在很多地方用,但有两个东西,目前基本只有 Windsurf 做到了一个比较完整、可用的形态:

DeepWiki(“代码百科”) + Codemaps(“代码地图”)

这俩是理解和改造大仓库时,非常关键的“组合技”。

1. DeepWiki:把“悬浮提示”升级成真正的代码百科

传统 IDE 的 hover 提示,能告诉你的通常只有:

- 类型信息

- 方法签名

- 有时候带一点 docstring

而 Windsurf 把 Devin 世界里的 DeepWiki 直接搬进来了:

- 你在代码里悬停到一个符号(函数、类、变量),

- 按

Cmd+Shift+Click(Mac),就能打开一个 DeepWiki 面板 里面不是冷冰冰的类型,而是一段自然语言的“说明书”:

- 这个函数是干嘛的

- 会在什么地方被调用

- 和哪些模块有关系

- 有时还会顺带解释设计意图

更重要的是,DeepWiki 和 Cascade 是打通的:

- 你可以一键把 DeepWiki 的解释“丢给” Cascade

- 让它基于这份解释继续帮你重构、写测试、找问题

这一点在我接手别人写的项目时特别有用:

- 不需要先去 Repo 里到处搜注释

- 只要沿着调用链一路往下读 +

Cmd+Shift+Click - 很快就能在脑子里构建出这条链路在干什么

可以简单理解为:

DeepWiki 把每一个“点”的信息密度拉满。

不是只告诉你“这是什么”,而是告诉你“它为什么在这、和谁一起工作”。

2. Codemaps:把“线和面”的结构画成图

DeepWiki 解决的是“点”的问题,但真实项目的痛苦在于:

- 函数都看懂了,却不知道整个系统怎么跑

- 不清楚请求从入口到出口,具体经过了哪些模块

- 重构时很难确定“往哪儿下刀最稳”

Codemaps 就是为这个场景设计的。

官方文档里的描述很准确:它是一个由专门 agent 驱动的代码地图系统:

- 它会遍历你的仓库,找出相关的文件和函数

- 自动生成一个分层的、可点击的结构视图

- 每个节点都可以直接跳回对应的文件和位置

对我来说,Codemaps 有三个非常现实的用法:

- 熟悉新项目:

- 打开 Codemaps,看“某个功能”涉及哪些文件

- 顺着图点下去,配合 DeepWiki 看注释,很快就能搞清楚一条业务链

- 设计重构方案:

- 在 Codemaps 里标记哪些节点是高耦合、哪些可以拆

- 再把 Codemap 用

@方式丢给 Cascade,让它按这个结构帮你拆任务

- 和团队沟通:

- Codemaps 本身是可以分享的(链接形式,需要团队授权)

- 不需要“口头讲一遍架构”,直接丢图 + 节点说明,所有人看的是同一张“地图”

简单总结就是:

- DeepWiki:解决“局部解释”(点)

- Codemaps:解决“整体结构”(线和面)

- 再加上 Cascade 和 MCP,就变成了一个“既能讲清楚、又能动手改”的闭环

在我目前体验过的 AI IDE 里,这种“DeepWiki + Codemaps”的一体化组合,基本是 Windsurf 独有的。

这也是我为什么说:它不只是“又一个 AI IDE”,而是把 Devin 那一套“代码理解工具链”塞进了 IDE 里。

四、真实场景里,它和 CLI 是怎么搭配的?

说了这么多能力,回到我每天真的在干的事,会更直观。

场景一:前端开发 + UI 调整

典型流程是这样的:

- Windsurf 里开项目 + 浏览器预览

- 在页面上选中有问题的区域,让 Cascade 帮忙定位到组件

- 对着组件代码,用 DeepWiki 看关键函数和状态

- 必要时起一个 Codemap,看这一页涉及哪些模块

- 和 Cascade 一起改样式 / 状态逻辑,一键应用 diff

在这套流程里:

- Windsurf 负责:前端预览、定位组件、看地图、做 diff

- Codex / Claude Code 负责:

- 帮我写一些“额外”的脚本,比如 mock 数据、临时转换工具

- 帮忙写文档和说明,或者对比几种 UI 实现方案

如果只用 CLI,这一套会变得非常割裂:

你得在浏览器、终端、编辑器之间来回切,人也很容易抽离上下文。

场景二:接手一个“历史悠久”的后端仓库

在这种场景里,我的节奏通常是:

- 先用 Codemaps 生成一张“项目地图”

- 沿着“路由入口 → 控制层 → 服务层 → 仓储层”这条线走一遍

- 对看不懂的函数,用 DeepWiki 按点打开说明

- 把关键模块解释发给 Cascade,让它汇总成一份“给后人看的概览文档”

- 再根据 Codemap 设计重构顺序,让 Cascade 分步打一批批 diff

这时 CLI 更多是在旁边打辅助:

- 帮我写迁移脚本

- 帮忙跑一次离线检查、生成测试数据

- 帮忙对“重构前后”的行为做对比验证

而 Windsurf 负责把这一切变成:

- 可视化的结构(Codemaps)

- 细粒度的解释(DeepWiki)

- 可执行的修改(Cascade diff + 测试)

五、适合谁?怎么理性决定要不要用 Windsurf?

我不认为所有人都需要 Windsurf,甚至不认为所有人都需要 AI IDE。

如果你只是偶尔写脚本、写配置,纯 CLI 就够了。

但如果你满足下面几条中的两三条,Windsurf 的价值会非常明显:

- 有一两个需要长期维护的大仓库,而不是只写一次性代码

- 前端 / 全栈开发占比不低,需要频繁在 UI 和代码之间切换

- 已经在用 Codex / Claude Code,希望找一个 IDE 做“主场”

- 在乎计费透明,讨厌黑盒配额和说不清的限流策略

- 想要在“理解旧代码 + 规划重构”这件事上有更系统的工具链,而不是全靠脑补

一个简单的试用建议是:

- 不要只跑官方 demo,用一个真实的“非关键项目”开一个月

- 用 Windsurf 干三件非常具体的事:

1)接手一段别人写的逻辑

2)做一处前端 UI 的整体调整

3)对某个子系统做一轮小范围重构 - 同时用 Codex / Claude Code 做“边上辅助”,看这套组合对你的效率有没有实打实的提升

最后的判断标准只有一个:

在 Codex + Claude Code 已经这么强的前提下,

Windsurf 有没有让“在真实仓库里写代码”这件事变得更轻松?

六、写在最后

从 7 月那两篇文章,到今天这篇“小结”,中间我经历了:

- 模型从 Sonnet 4 到 Sonnet 4.5、Opus 4.5、GPT-5.1-Codex Max

- 工具从“大家都模仿 Cursor”到“AI CLI + AI IDE + MCP 各自找到定位”

- 计费模式从“各种花式无限制”到“越来越多人开始在意透明度和可预期性”

在这个过程中,很多工具来来去去,但目前仍然稳坐在我主力工具链里的,只有三个名字:

- Codex

- Claude Code

- Windsurf

如果你也想尝试一下 Windsurf,可以从这里开始:

- Windsurf 推荐链接:

https://windsurf.com/refer?referral_code=ea48c8a5e9

更重要的是,不要停留在“哪个工具更火”的层面。

拿出你自己的真实项目,跑上两三周,用数据和体感去回答这句话:

当潮水退去,在你的项目里真正帮你解决问题的,是哪几个工具?欢迎留言讨论!

文档信息

- 本文作者:王翊仰

- 本文链接:https://www.wangyiyang.cc/2025/12/08/windsurf-still-my-choice/

- 版权声明:自由转载-非商用-非衍生-保持署名(创意共享3.0许可证)